下载Ollama

点击此处下载Ollama,选择对应的系统版本下载即可。

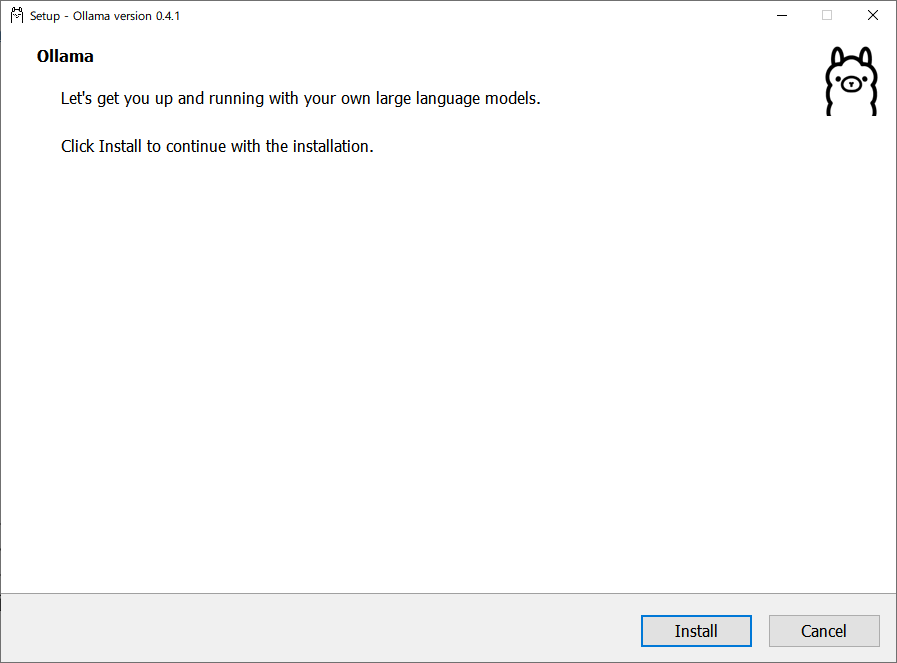

随后来到安装界面,点击install,无需进行其他操作,等待完成即可。

调取Ollama

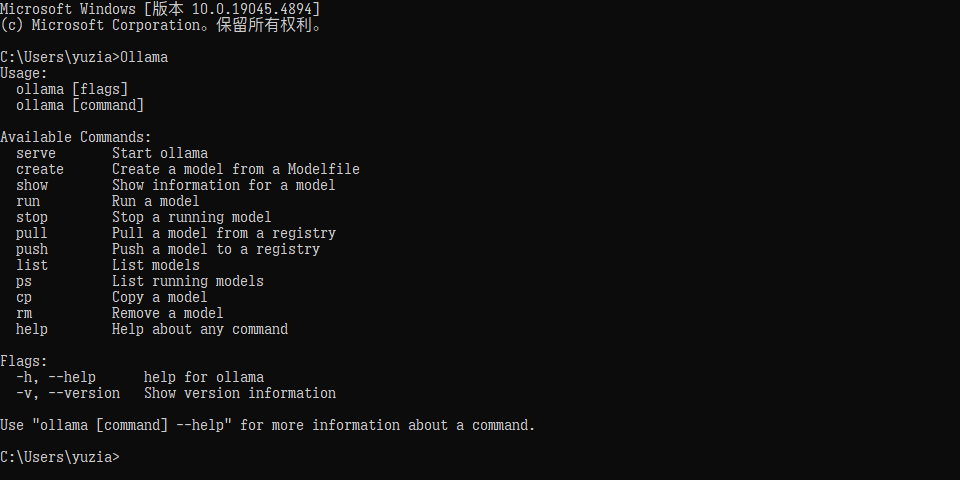

由于Ollama没有图形界面,所以需要使用命令行工具调取。

输入

|

|

查看Ollama是否能被正常调用,如下图

显示以下结果即为正常。

下载模型

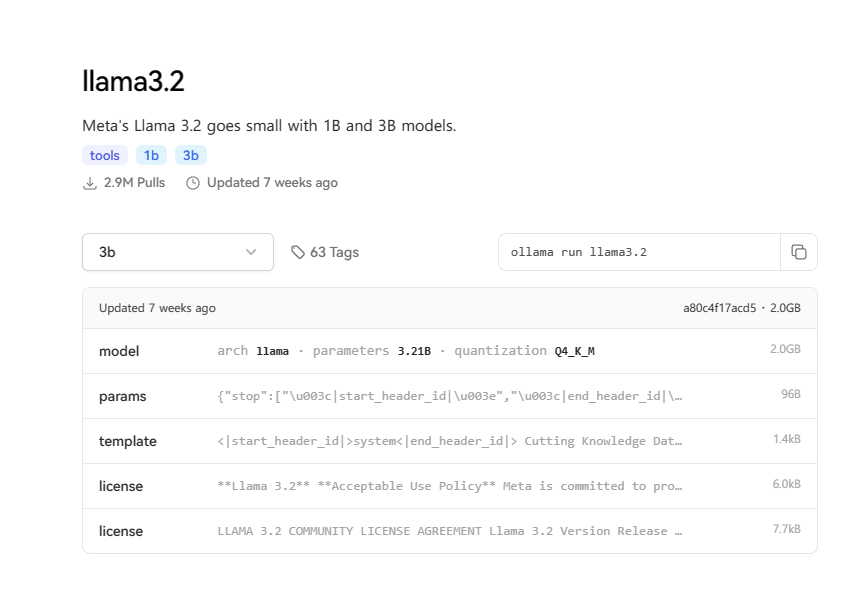

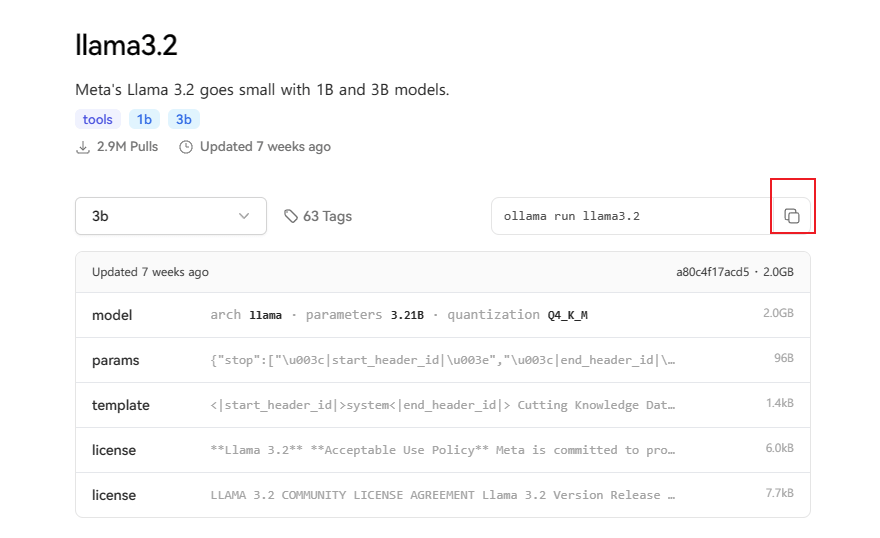

如果Ollama正常,前往Ollama官网模型地址下载需要的模型。

在Ollama模型地址打开任意一个模型,如下图演示的Ollama3.2模型。

点击此处代码块右边的复制按键。

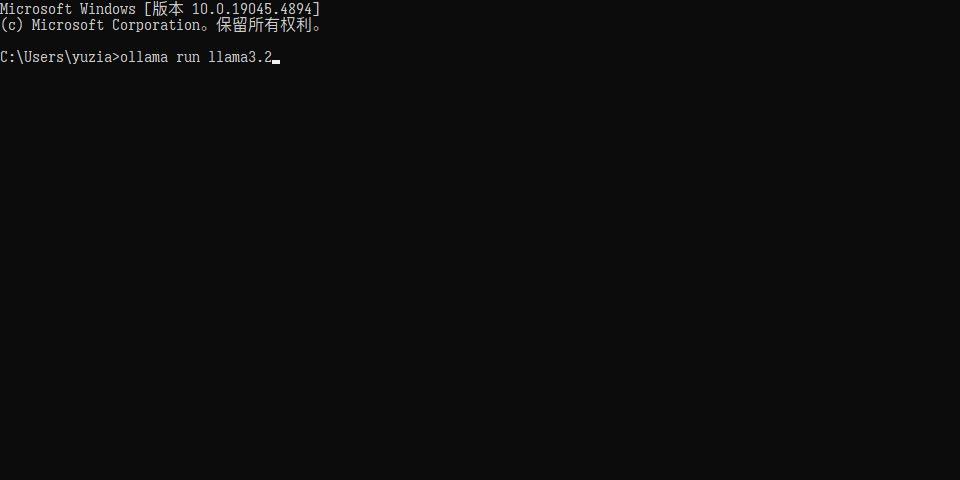

复制完成后打开命令行,将复制后的代码粘贴进去。

按下回车后即可开始下载。

查看下载的模型文件与调用

可以通过输入

|

|

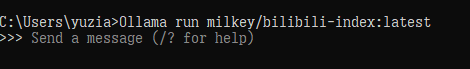

查看下载的模型文件。如需调用,输入“

|

|

看到这样的提示则代表调用正常,就可以愉快的与大模型对话了,如果需要退出,可以直接关闭命令行,Ollama在一定时间后会自动释放显存,也可以输入“/bye”指令退出。

常见问题以及解决方案

time out报错

如果在中途中出现time out报错,是因为国内拉取不稳定,多复制几次下载即可。